DiffRhythm: 최신 AI 기반 풀렝스 노래 생성 모델 완벽 가이드

🎵 AI 음악 생성의 새로운 지평: DiffRhythm 모델 심층 분석

디지털 음악 창작 분야에서 혁신적인 돌파구를 제시하는 DiffRhythm은 가사와 스타일 프롬프트만으로 풀렝스 노래를 생성할 수 있는 확산 기반 AI 모델입니다. 이 가이드에서는 DiffRhythm의 설치부터 실행, 그리고 활용 방법까지 단계별로 자세히 알아보겠습니다.

📊 DiffRhythm 주요 특징 한눈에 보기

📈 DiffRhythm 모델 버전 비교

모델 버전 최대 지속 시간 VRAM 요구사항 특징 Huggingface 링크

| DiffRhythm-base | 1분 35초 | 최소 8GB | 기본 모델, --chunked 옵션 지원 | 링크 |

| DiffRhythm-full | 4분 45초 | 12GB 이상 권장 | 장시간 노래 생성에 최적화 | 링크 |

| DiffRhythm-vae | - | - | 확산 과정에 사용되는 VAE 모델 | 링크 |

🚀 DiffRhythm 설치 및 환경 설정 방법

DiffRhythm을 시작하기 위한 단계별 설치 가이드를 제공합니다. Python 3.10 환경에서 최적의 성능을 발휘합니다.

📋 설치 단계별 명령어

# 1. 리포지토리 클론

git clone https://github.com/ASLP-lab/DiffRhythm

# 2. 프로젝트 디렉토리로 이동

cd DiffRhythm

# 3-A. Conda 환경 설정 (선택 1)

conda create -n diffrhythm python=3.10

conda activate diffrhythm

# 3-B. 가상 환경 설정 (선택 2)

python -m venv venv

# Linux/macOS:

source venv/bin/activate

# Windows:

.\venv\Scripts\activate

# 4. 요구 사항 설치

pip install -r requirements.txt

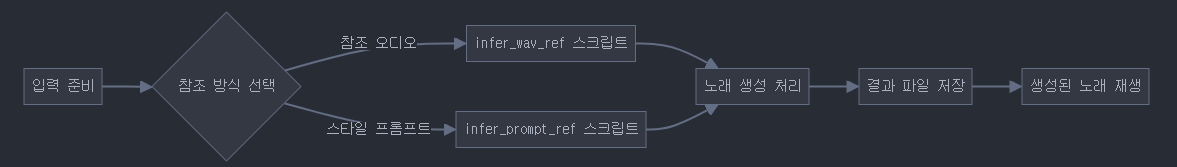

🎨 DiffRhythm 사용 방법 가이드

DiffRhythm은 간단한 명령어로 다양한 스타일의 노래를 생성할 수 있습니다. 여기서는 운영체제별 스크립트 사용법을 설명합니다.

🖥️ 운영체제별 실행 스크립트

Linux/macOS 사용자

# 참조 오디오를 사용한 노래 생성

./infer_wav_ref.sh

# 스타일 프롬프트를 사용한 노래 생성

./infer_prompt_ref.sh

Windows 사용자

# 참조 오디오를 사용한 노래 생성

infer_wav_ref.bat

# 스타일 프롬프트를 사용한 노래 생성

infer_prompt_ref.bat

메모리 최적화 옵션 (8GB VRAM 환경)

# --chunked 옵션을 추가하여 메모리 사용 최적화

./infer_prompt_ref.sh --chunked

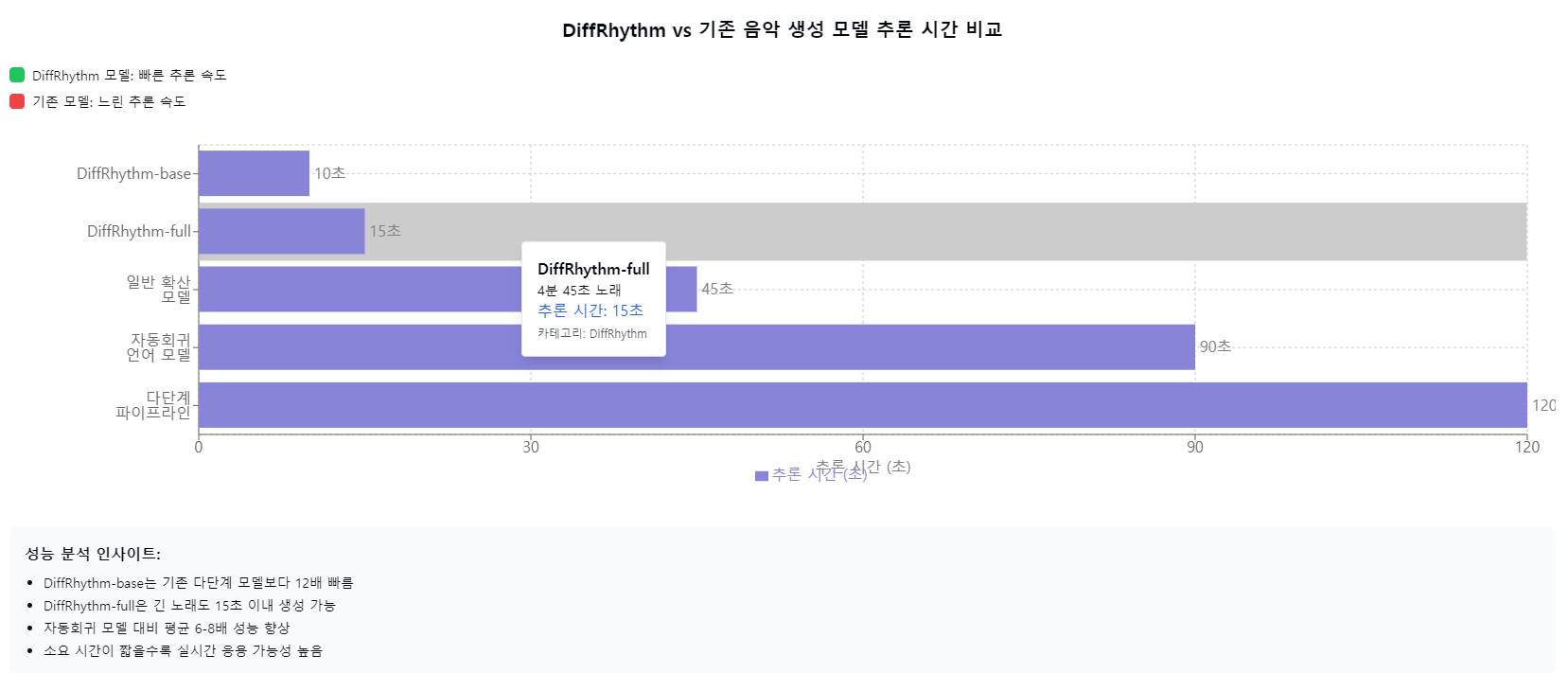

📈 DiffRhythm 성능 분석 및 활용 사례

DiffRhythm의 성능을 다양한 측면에서 분석하고, 실제 활용 사례를 살펴봅니다.

🏆 DiffRhythm의 기술적 장점

DiffRhythm의 주요 기술적 혁신

- 확산 기반 비자동회귀 구조

- 기존 자동회귀 모델보다 10배 이상 빠른 추론 속도

- 단일 단계에서 전체 노래 생성 가능

- 잠재 확산(Latent Diffusion) 아키텍처

- 효율적인 메모리 사용으로 긴 노래 생성 가능

- VAE를 통한 고품질 오디오 인코딩 및 디코딩

- 간소화된 파이프라인

- 복잡한 데이터 전처리 과정 제거

- 직관적인 사용자 인터페이스로 접근성 향상

- 스타일 프롬프트 시스템

- 텍스트 기반 스타일 지정으로 다양한 음악 스타일 생성

- 참조 오디오 기반 스타일 모방 기능

- 확장 가능한 오픈소스 구조

- 학계 및 산업계의 추가 연구 촉진

- 커뮤니티 기반 개선 및 확장 가능성

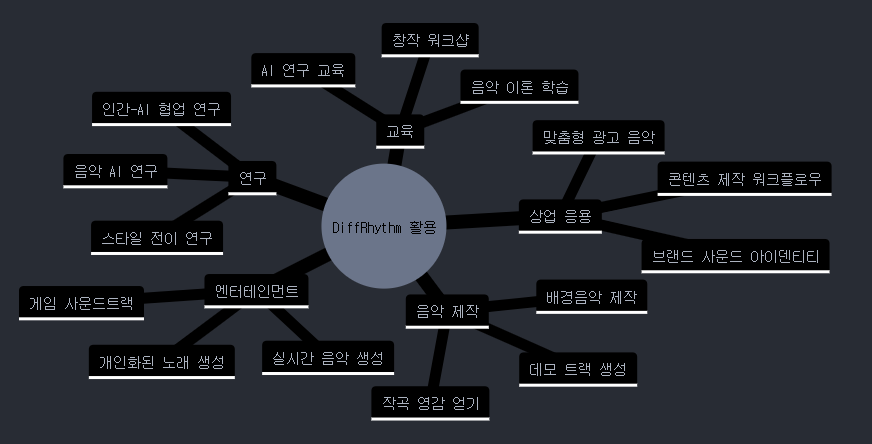

💡 DiffRhythm 활용 시나리오 및 응용 방안

DiffRhythm을 활용한 다양한 실제 사용 사례와 응용 방안을 살펴봅니다.

🔍 자주 묻는 질문 (FAQ)

DiffRhythm 자주 묻는 질문

1. DiffRhythm은 어떤 언어의 가사를 지원하나요?

DiffRhythm은 다양한 언어의 가사를 지원하지만, 영어와 중국어에서 가장 우수한 성능을 보입니다. 다른 언어도 사용 가능하나 발음의 정확도는 언어에 따라 달라질 수 있습니다.

2. 최소 하드웨어 요구사항은 무엇인가요?

DiffRhythm-base 모델을 사용하려면 최소 8GB VRAM이 필요합니다. 메모리가 제한된 환경에서는 --chunked 옵션을 사용하여 메모리 사용을 최적화할 수 있습니다. DiffRhythm-full 모델은 12GB 이상의 VRAM을 권장합니다.

3. 생성된 노래의 저작권은 어떻게 되나요?

DiffRhythm으로 생성된 콘텐츠의 저작권 정책은 프로젝트의 라이선스를 따릅니다. 상업적 사용 전 라이선스 조항을 확인하세요. 일반적으로 연구 및 개인 용도로는 자유롭게 사용 가능합니다.

4. 학습 코드는 언제 공개되나요?

현재 학습 코드는 "Coming soon..."으로 표시되어 있습니다. 개발팀은 추후 업데이트를 통해 학습 코드를 공개할 예정입니다. GitHub 리포지토리를 정기적으로 확인하세요.

5. 데모 외에 DiffRhythm을 온라인에서 사용할 수 있나요?

현재 Huggingface Space에서 제공되는 공식 데모가 온라인에서 DiffRhythm을 사용할 수 있는 주요 방법입니다. 대규모 작업이나 커스터마이징이 필요한 경우 로컬 설치를 권장합니다.

6. 기존 오디오 파일에 DiffRhythm을 적용할 수 있나요?

현재 버전에서는 참조 오디오의 스타일을 새 노래에 적용하는 기능은 지원하지만, 기존 오디오 파일을 직접 수정하거나 변환하는 기능은 제공하지 않습니다.

🔮 DiffRhythm의 미래와 AI 음악 생성의 전망

AI 음악 생성의 미래와 DiffRhythm

단기적 발전 가능성

- 모델 성능 향상

- 더 높은 품질의 보컬 및 악기 사운드 생성

- 다양한 장르와 스타일에 대한 지원 확장

- 더 긴 노래 생성 능력 (5분 이상)

- 사용자 인터페이스 개선

- 더 직관적인 웹 인터페이스 구축

- 실시간 피드백 및 조정 기능 추가

- 모바일 플랫폼 지원

- 학습 코드 공개 및 커뮤니티 발전

- 사용자 정의 데이터셋으로 모델 미세 조정 지원

- 다양한 언어 및 음악 스타일에 특화된 파생 모델 등장

- 오픈 소스 커뮤니티 기여를 통한 기능 확장

장기적 전망

- AI와 인간 음악가의 협업 모델

- 작곡가와 AI의 공동 창작 워크플로우 확립

- 실시간 음악 생성 및 퍼포먼스 도구로 발전

- 개인화된 음악 교육 및 창작 지원 시스템

- 산업적 응용 확대

- 엔터테인먼트 산업에서의 상용화 증가

- 맞춤형 미디어 콘텐츠 제작 자동화

- 음악 치료 및 웰빙 응용 프로그램

- 기술적 혁신 방향

- 멀티모달 입력(텍스트, 오디오, 이미지, 비디오)을 통한 음악 생성

- 감정 및 맥락 인식 음악 생성 기능

- 저전력 디바이스에서도 실행 가능한 경량화 모델

이러한 발전은 AI 음악 생성 분야의 민주화를 가속화하고, 창작의 장벽을 낮추며, 새로운 형태의 음악적 표현과 경험을 가능하게 할 것입니다.

📚 참고 자료 및 리소스

DiffRhythm 주요 참고 자료 및 리소스

공식 리소스

모델 다운로드 링크

학습 및 참고 자료

- 연락처: nzqiann@gmail.com

- 인용 형식: @article{ning2025diffrhythm, journal={arXiv preprint arXiv:2503.01183}, year={2025}}

관련 AI 음악 생성 리소스

- AudioLDM - 텍스트로부터 오디오 생성 모델

- MusicLM - Google의 음악 생성 모델

- Stable Audio - Stability AI의 오디오 생성 모델

- Jukebox - OpenAI의 음악 생성 모델

커뮤니티 및 포럼

📑 결론

DiffRhythm은 AI 음악 생성 분야에 혁신적인 접근 방식을 제시하는 오픈소스 프로젝트입니다. 확산 기반 모델을 통해 풀렝스 노래를 빠르고 효율적으로 생성할 수 있으며, 간단한 설치 과정과 직관적인 사용법으로 누구나 쉽게 활용할 수 있습니다.

이 가이드를 통해 DiffRhythm의 설치부터 실행, 그리고 다양한 활용 방안까지 살펴보았습니다. AI 음악 생성에 관심이 있는 연구자, 개발자, 음악 애호가 모두에게 유용한 자료가 되기를 바랍니다.

이 블로그 포스트에 대한 궁금한 점이나 DiffRhythm 사용 경험을 댓글로 공유해주세요! 여러분의 AI 음악 창작 여정을 응원합니다. 🎵

'영상생성AI > 비디오 오디오 생성 Site' 카테고리의 다른 글

| CSM-1B: 대화형 음성 모델 설정 및 사용 완벽 가이드 (2025) (0) | 2025.03.18 |

|---|---|

| Tight Inversion 텍스트 기반 이미지 편집 완벽 가이드: 단계별 튜토리얼 (1) | 2025.03.18 |

| "fal.ai 클라우드 vs 로컬 GPU AI 이미지 생성 비용 효율성 비교 - 2025년 최신 성능 및 가격 분석" (3) | 2025.03.14 |

| "Hailuo AI Video 텍스트 기반 무료 영상 생성 도구 사용법 - 6초 쇼츠 콘텐츠 제작 단계별 가이드" (2) | 2025.03.14 |

| FLORA AI 통합 지능형 캔버스 플랫폼 완벽 가이드 (0) | 2025.03.13 |